Här är Zoom AI Companion, din nya AI-assistent!

Öka produktiviteten och teamsamarbetet med Zoom AI Companion, tillgänglig utan extra kostnad med berättigande betalda Zoom-planer.

Zooms CTO, Xuedong Huang, diskuterar hur små språkmodeller (SLM) driver vår vision för hur AI-agenter samarbetar i en federerad strategi för att förbättra dagliga uppgifter.

Uppdaterad den February 25, 2025

Publicerad den February 19, 2025

Xuedong Huang är Chief Technology Officer (CTO). Före sin roll hos Zoom arbetade han på Microsoft, där han tjänstgjorde som Azure AI CTO och Technical Fellow. Han har haft en mycket framgångsrik karriär inom AI: Han startade Microsofts grupp för talteknik 1993 och ledde Microsofts AI-team för att uppnå flera av branschens första milstolpar för mänsklig paritet inom taligenkänning, maskinöversättningar, naturlig språkförståelse och datorvision. Han är en IEEE och ACM Fellow samt en invald medlem i National Academy of Engineering och American Academy of Arts and Sciences.

Xuedong tog sin doktorsexamen i elektroteknik från University of Edinburgh 1989 (sponsrad av British ORS och Edinburgh University Scholarship), sin masterexamen i datavetenskap från Tsinghua University 1984 och sin kandidatexamen i datavetenskap från Hunan University 1982.

På Zoom fokuserar vi på innovation som är drivkraften i vår fortlöpande utforskning av AI-prioriterad omvandling med Zoom AI Companion. Under det senaste året har jag delat hur vårt federerade tillvägagångssätt levererar högkvalitativa resultat och hur vårt fokus på röstigenkänningskvalitet skapar en bättre grund för våra andra AI-funktioner. I takt med att artificiell intelligens fortsätter att förbättras accelererar vi implementeringen av agentisk AI.

Hittills har artificiell intelligens förlitat sig på storskaliga språkmodeller (LLM, Large Language Model) för att svara på användarpromptar och leverera genererade svar. Det finns dock många fler möjligheter när vi överväger hur SLM:er kan möjliggöra skräddarsydda AI-agenter. Vi utvecklar AI Companion för att göra det möjligt för agentisk AI att hantera olika flerstegsåtgärder åt dig.

När vi ser på AI som agenter istället för fristående färdigheter och svar innebär det att de gör mer än att bara mata in kommandon för att ge enkla resultat. De bör istället fungera som en förlängning av oss själva och våra mål. För att göra detta har våra AI-agenter följande egenskaper:

För att lättare implementera dessa AI-agenter är vi glada att kunna presentera en stor milstolpe på resan: vår nyutvecklade Small Language Model (SLM) har uppnått topprestanda inom kategorin för 2 miljarder parametrar på den offentliga topplistan för riktmärken. Genom anpassning via Zooms kommande AI Studio designar vi Zooms SLM för att uppnå samma kvalitet som branschens ledande LLM inom specialiserade arbetslaster. Detta kommer göra att AI Companion kan utföra komplexa agentiska AI-uppgifter med flera AI-agenter som arbetar tillsammans och uppnår oöverträffad kostnadseffektivitet.

I Zooms federerade AI-strategi förespråkar vi samordning av flera anpassade modeller istället för att förlita oss på en enda, omfattande stor modell. Zooms SLM:er är utformade för att stärka tillvägagångssättet genom att optimera specifika uppgifter. Genom att fördela arbetslaster över anpassade SLM:er med motsvarande agenter – samtidigt som vi använder ledande LLM:er – strävar vi efter att uppnå flera viktiga fördelar:

Låt oss diskutera vad genombrottet betyder och hur det står sig mot ledande modeller.

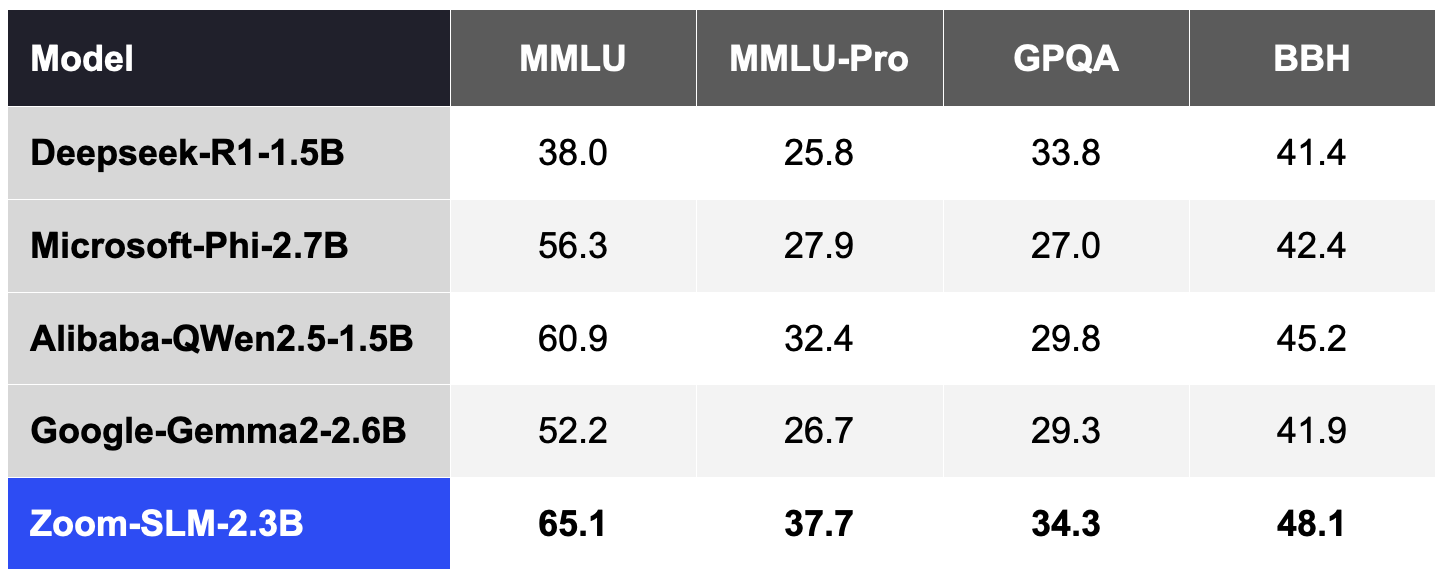

För att skapa Zooms SLM använde vi 6 biljoner tokens med flerspråkig data och 256 stycken Nvidia H100 GPU:er. Från början till slut tog hela träningscykeln ungefär 30 dagar. Följande tabeller beskriver hur Zooms SLM-kapacitet kan jämföras med andra modeller inom flera offentliga riktmärken baserat på våra interna tester:

I enlighet med communityns gemensamma praxis utvärderade vi noggrannheten av dessa riktmärken med hjälp av verktyget Lighteval, som gav 5 exempel på MMLU och MMLU-Pro, 2 exempel på GPQA och 3 exempel på BBH.

Tabell 1. Zoom SLM jämfört med andra SLM:er i 2B-kategorin (högre poäng är bättre).

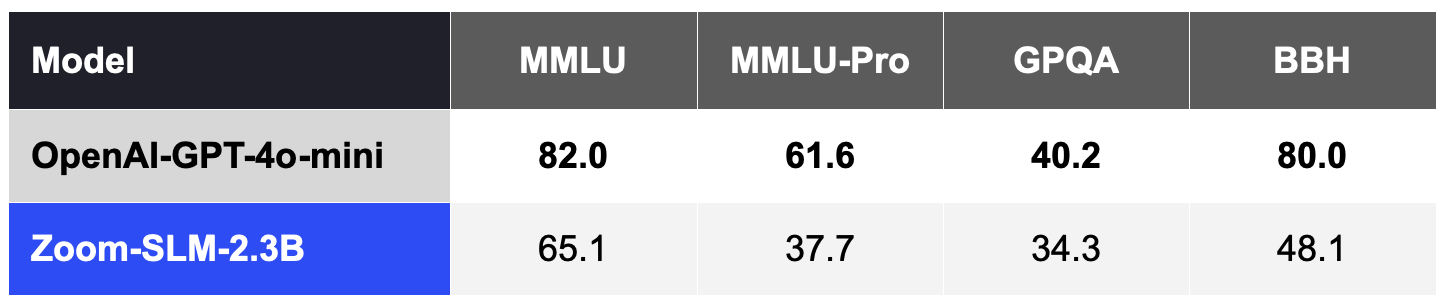

Generellt sett är SLM:er inte lika starka inom dessa kvalitetsmått än ledande LLM:er, såsom OpenAI:s GPT-4o-mini, om de inte har anpassats för en specifik domän eller uppgift, vilket visas i tabell 2.

Tabell 2. Zooms SLM, utan anpassning, är inte lika stark som LLM:er efter 2B-kategorin, såsom OpenAI GPT 4o-mini.

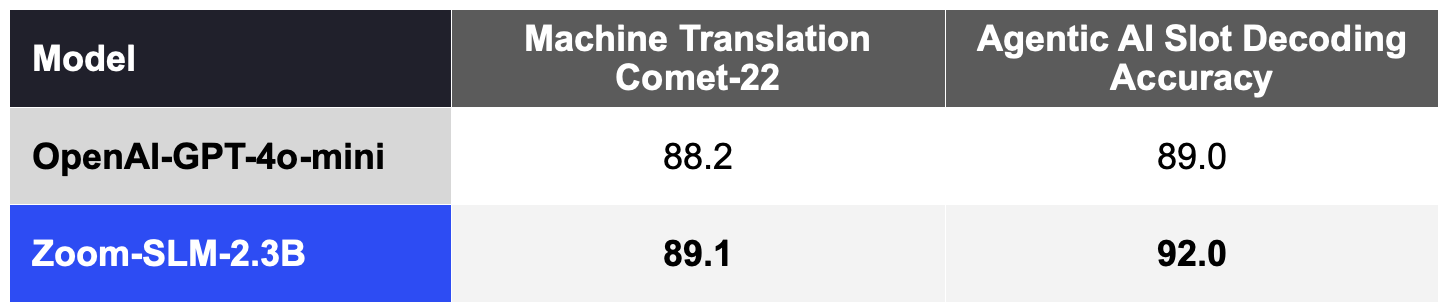

Det mest intressanta resultatet är dock att dessa SLM:er kan få exceptionella förmågor när de anpassas för en specialiserad uppgift. Genom anpassning med Zooms AI Studio förväntar vi oss att kvalitetsgapet minskas gentemot dyrare LLM:er. Anpassade SLM:er kan fungera som specialiserade agenter som utför viktiga uppgifter när de samordnas med LLM:er, där förbättrad noggrannhet, hastighet och kostnadseffektivitet för varje AI-agent prioriteras.

Anpassade SLM:er kan utmärka sig inom uppgifter som maskinöversättning. Genom att anpassa SLM med 11,5 miljarder tokens (inklusive syntetiska data) som är utformade för maskinöversättning har vi avsevärt förbättrat de allmänt antagna COMET-22-mätvärderna på kvalitet över 14 språkpar, inklusive stora språk som kinesiska, engelska, franska, japanska, portugisiska och spanska som visas i tabell 3.

Våra SLM:er kan också anpassas för att ge stöd för AI Companions agentiska AI-riktmärke för fackavkodning, vilket mäter hur väl modellen tolkar användarkommandon under åtgärdsutförande. Med 2 miljarder syntetiska tokens för agentisk AI-domändata överträffar den anpassade SLM:en också GPT-4o-mini, vilket visas i tabell 3.

Denna kombination av effektivitet och anpassningsförmåga är utformad för att Zoom ska kunna tillgängliggöra vår förbättrade maskinöversättning till kunder världen över, samt för att stötta Zoom AI Studio i anpassningen av specifika arbetslaster för agentisk AI.

Tabell 3. Anpassad Zoom SLM jämfört med OpenAI GPT-4o-mini i specialiserade arbetslaster, där högre poäng är bättre.

Dessa skräddarsydda SLM:er kommer att utgöra ryggraden i våra AI-agenter och köras effektivare och ge resultat som står sig mot de dyrare LLM:er som används idag. Med vår federerade AI kommer dessa AI-agenter och färdigheter att bidra till oöverträffad effektivitet, kostnadsbesparingar och precision.

Vi är stolta över våra framsteg – och det här är bara början. Vår vision är att utrusta varje organisation med AI-agenter som levererar kostnadseffektiva och högpresterande lösningar. Med tillskottet av AI-agenter och SLM:er finns AI Companion här för att hjälpa dig skapa en arbetsplats där du kan få mer gjort och leverera dina bästa resultat.