Ti presentiamo Zoom AI Companion: il tuo nuovo assistente di IA.

Migliora produttività e collaborazione di team grazie a Zoom AI Companion, disponibile senza costi aggiuntivi con i piani Zoom a pagamento idonei.

Il CTO di Zoom, Xuedong Huang, parla di come i modelli linguistici di piccole dimensioni (SLM) guidano la nostra vision, ossia fare in modo che gli agenti di intelligenza artificiale collaborino in un approccio federato per migliorare le attività quotidiane.

Data di aggiornamento February 25, 2025

Pubblicato in data February 19, 2025

Xuedong Huang è il Chief Technology Officer (CTO). Prima di far parte di Zoom, ha lavorato in Microsoft, dove ha ricoperto il ruolo di CTO e Technical Fellow di Azure AI. La sua è una carriera brillante nel settore dell'IA: ha fondato il gruppo di tecnologia vocale di Microsoft nel 1993, ha diretto i team per l'IA di Microsoft in modo da raggiungere molti dei primi traguardi della parità umana del settore nel riconoscimento vocale, nella traduzione automatica, nella comprensione del linguaggio naturale e nella visione computerizzata. È un IEEE e ACM Fellow e un membro eletto della National Academy of Engineering e dell'American Academy of Arts and Sciences.

Xuedong ha conseguito il dottorato di ricerca in ingegneria elettrica presso l'Edinburgh University nel 1989 (sponsorizzato dall'ORS britannico e con una borsa di studio dell'università di Edimburgo), il master in informatica presso la Tsinghua University nel 1984 e la laurea in CS presso la Hunan University nel 1982.

In Zoom, rimaniamo concentrati sull'innovazione, che guida la nostra continua esplorazione della trasformazione AI-first tramite Zoom AI Companion. Nell'ultimo anno, ho spiegato come il nostro approccio federato offra risultati di alta qualità e come la nostra attenzione alla qualità del riconoscimento vocale crei una base migliore per le altre funzionalità di intelligenza artificiale. Con il progressivo miglioramento dell'intelligenza artificiale, stiamo accelerando l'adozione dell'IA agentica.

Finora, l'intelligenza artificiale si è affidata a modelli linguistici di grandi dimensioni (LLM) per rispondere alle richieste degli utenti e fornire risposte generate. Tuttavia, le opportunità sono maggiori se consideriamo che gli SLM possono abilitare agenti di intelligenza artificiale personalizzati. Stiamo sviluppando AI Companion per supportare l'IA agentica nella gestione di una serie di azioni in più fasi per tuo conto.

Quando consideriamo l'IA come agente invece che come abilità e risposte indipendenti, significa che va oltre l'inserimento di prompt per ottenere semplici risultati e dovrebbe invece essere un'estensione di noi stessi e dei nostri obiettivi. A tal fine, i nostri agenti di IA presentano le seguenti caratteristiche:

Per rendere realtà questi agenti di intelligenza artificiale, siamo entusiasti di annunciare un traguardo significativo in questo percorso: il nostro Small Language Model (SLM) di recente sviluppo ha raggiunto prestazioni all'avanguardia nella categoria dei 2 miliardi di parametri nella classifica pubblica di benchmark. Attraverso la personalizzazione con AI Studio di Zoom, di prossima uscita, stiamo progettando gli SLM di Zoom affinché raggiungano la qualità del principale LLM del settore nei carichi di lavoro specializzati. Questo permetterà ad AI Companion per eseguire attività complesse di IA agentica con molteplici agenti di intelligenza artificiale che lavorano insieme con una convenienza impareggiabile.

Nell'approccio federato all'IA di Zoom, invece di dipendere da un unico modello ampio e completo, promuoviamo l'orchestrazione di più modelli personalizzati. Gli SLM di Zoom sono progettati per migliorare questo approccio grazie all'ottimizzazione per compiti specifici. Distribuendo i carichi di lavoro su SLM personalizzati con agenti corrispondenti e sfruttando i principali LLM, puntiamo a ottenere diversi vantaggi importanti:

Parliamo di cosa significa questa innovazione e come si rapporta esattamente con i modelli principali.

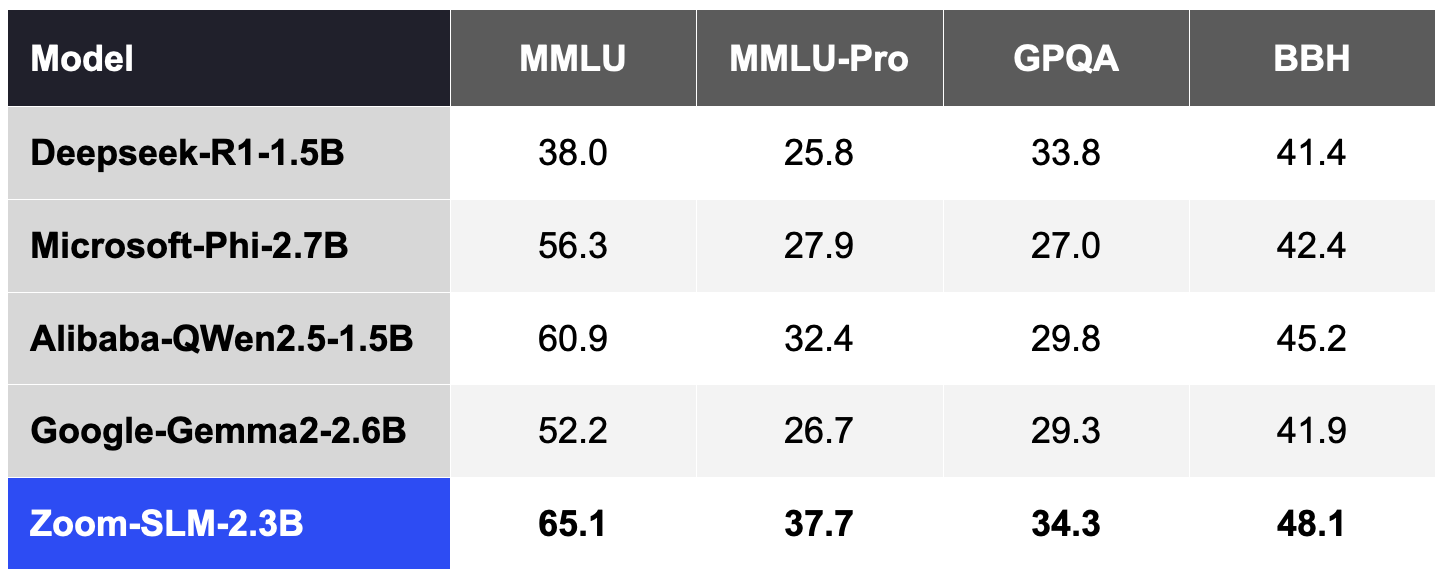

Per creare l'SLM di Zoom, abbiamo utilizzato 6 trilioni di token di dati multilingue e 256 GPU Nvidia H100. Dall'inizio alla fine, l'intero ciclo di formazione è durato circa 30 giorni. Le tabelle seguenti mettono la funzionalità SLM di Zoom a confronto con altri modelli in diversi benchmark pubblici, sulla base dei nostri test interni:

Secondo la prassi comune della comunità, abbiamo valutato la precisione di tali benchmark con lo strumento Lighteval, che ha fornito 5 esempi su MMLU e MMLU-Pro, 2 esempi su GPQA e 3 esempi su BBH.

Tabella 1. SLM di Zoom a confronto con altri SLM nella categoria 2B (punteggi più alti indicano prestazioni migliori).

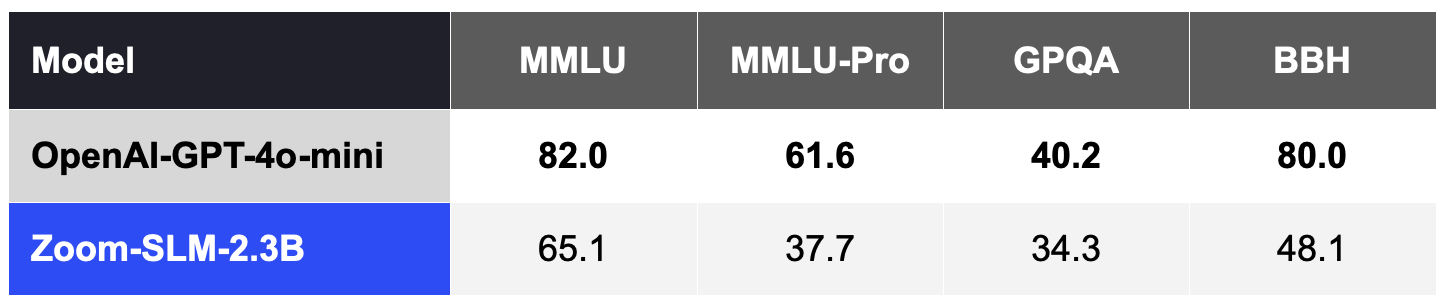

In generale, senza personalizzazione su un dominio o un compito specifico, come mostrato nella Tabella 2, gli SLM rimangono meno competitivi in queste misurazioni di qualità rispetto ai principali LLM come GPT-4o-mini di OpenAI.

Tabella 2. L'SLM di Zoom, senza personalizzazione, è meno competitivo rispetto agli LLM oltre la categoria 2B, come GPT-4o mini di OpenAI.

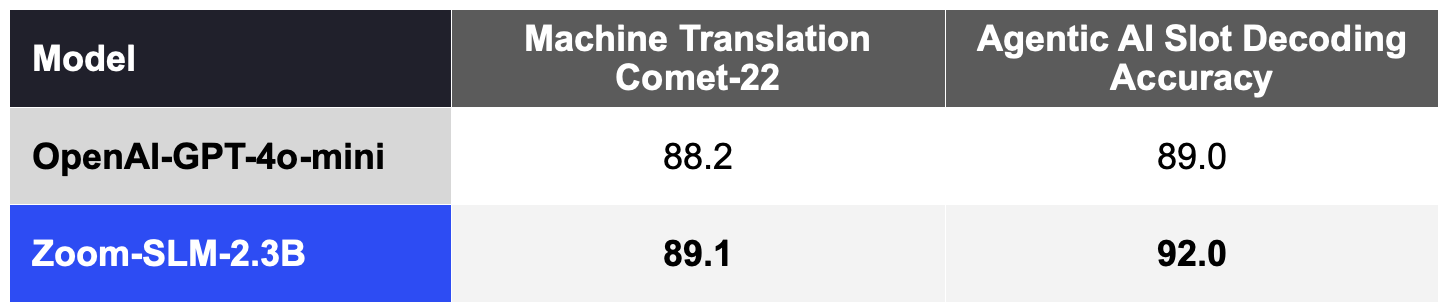

Tuttavia, il risultato più interessante è che questi SLM possono offrire capacità eccezionali se personalizzati per un compito specializzato. Attraverso la personalizzazione con AI Studio di Zoom, ci aspettiamo di ridurre efficacemente il divario di qualità rispetto agli LLM più costosi. Gli SLM personalizzati possono fungere da agenti specializzati per svolgere compiti chiave in collaborazione con gli LLM, dando priorità al miglioramento dell'accuratezza, della velocità e dell'efficacia dei costi per ciascun agente AI.

Gli SLM personalizzati possono eccellere in compiti come la traduzione automatica. Adattando l'SLM con 11,5 miliardi di token (compresi i dati sintetici) progettati per la traduzione automatica, abbiamo migliorato in modo significativo le metriche di qualità COMET-22, ampiamente adottate, su 14 coppie di lingue, comprese lingue importanti come il cinese, l'inglese, il francese, il giapponese, il portoghese e lo spagnolo come mostrato nella Tabella 3.

I nostri SLM possono essere personalizzati per supportare il benchmark dell’IA agentica di AI Companion nella decodifica degli slot, che misura l'efficacia del modello nell'interpretare i comandi dell’utente per l’esecuzione delle azioni. Con 2 miliardi di token sintetici per i dati di dominio dell'IA agentica, l'SLM personalizzato supera anche GPT-4o-mini, come mostrato nella Tabella 3.

Questa combinazione di efficienza e adattabilità è progettata per consentire a Zoom di proporre la nostra traduzione automatica notevolmente migliorata ai clienti di tutto il mondo, oltre a supportare Zoom AI Studio nella personalizzazione per specifici carichi di lavoro di IA agentica.

Tabella 3. Zoom SLM personalizzato vs. GPT-4o-mini di OpenAI in carichi di lavoro specializzati: punteggi più alti indicano prestazioni migliori.

Questi SLM personalizzati saranno il pilastro dei nostri agenti di intelligenza artificiale, operando in modo più efficiente e con risultati comparabili ai più costosi LLM che le persone usano attualmente. Utilizzando la nostra intelligenza artificiale federata, questi agenti e queste competenze di intelligenza artificiale contribuiranno a ottenere efficienza, costi e precisione senza pari.

Siamo orgogliosi dei nostri progressi, e questo è solo l'inizio. La nostra vision è arrivare a dotare ogni organizzazione di agenti di intelligenza artificiale che offrano soluzioni convenienti e ad alte prestazioni. Con le capacità aggiuntive degli agenti AI e degli SLM, AI Companion è qui per aiutarti a creare un ambiente di lavoro in cui puoi ottenere di più e dare il meglio di te.