Perkenalkan Zoom AI Companion, asisten AI baru Anda!

Tingkatkan produktivitas dan kolaborasi tim dengan Zoom AI Companion, yang sudah disertakan dalam paket Zoom berbayar Anda tanpa biaya tambahan.

CTO Zoom, Xuedong Huang, membahas bagaimana model bahasa kecil (SLM) mendorong visi kami agar agen AI dapat bekerja sama dalam pendekatan gabungan untuk meningkatkan tugas sehari-hari Anda.

Diperbarui pada February 25, 2025

Diterbitkan pada February 19, 2025

Xuedong Huang adalah Chief Technology Officer (CTO) Zoom. Sebelum bergabung dengan Zoom, dia bekerja di Microsoft sebagai CTO Azure AI dan Technical Fellow. Kariernya di bidang AI sangat cemerlang: dia mendirikan grup teknologi ucapan Microsoft pada tahun 1993, memimpin tim AI Microsoft untuk mencapai beberapa tonggak sejarah pertama di industri dalam pengenalan ucapan, terjemahan mesin, pemahaman bahasa alami, dan penglihatan komputer. Dia juga merupakan Fellow IEEE dan ACM, serta anggota terpilih dari National Academy of Engineering dan American Academy of Arts and Sciences.

Xuedong mendapatkan gelar Ph.D. dalam Ilmu Elektro dari Universitas Edinburgh pada tahun 1989 (disponsori oleh British ORS dan Beasiswa Universitas Edinburgh), gelar MS dalam Ilmu Komputer dari Universitas Tsinghua pada tahun 1984, dan gelar BS dalam Ilmu Komputer dari Universitas Hunan pada tahun 1982.

Di Zoom, kami terus fokus pada inovasi yang mendorong eksplorasi berkelanjutan dalam transformasi berbasis AI melalui Zoom AI Companion. Dalam setahun terakhir, saya telah berbagi bagaimana pendekatan federasi kami menghasilkan kualitas tinggi dan bagaimana fokus kami pada kualitas pengenalan suara menciptakan fondasi yang lebih baik untuk fitur AI lainnya. Seiring dengan peningkatan kecerdasan buatan, kami mempercepat adopsi AI agentik.

Sejauh ini, kecerdasan buatan telah mengandalkan model bahasa besar (LLM) untuk menanggapi permintaan pengguna dan memberikan respons yang dihasilkan. Namun, ada lebih banyak peluang yang tersedia ketika kita mempertimbangkan bagaimana SLM dapat memungkinkan agen AI yang dipersonalisasi. Kami sedang membangun AI Companion untuk memberikan dukungan kepada AI Agentik dalam mengelola serangkaian tindakan berbagai langkah atas nama Anda.

Ketika kita menganggap AI sebagai agen, bukan sekadar keterampilan dan respons yang berdiri sendiri, ini berarti bahwa mereka melampaui sekadar memasukkan petunjuk untuk memberikan hasil sederhana dan seharusnya menjadi perpanjangan dari diri kita dan tujuan kita. Untuk melakukan ini, agen AI kami memiliki karakteristik berikut:

Untuk membantu mewujudkan agen AI ini, kami dengan bangga mengumumkan pencapaian penting: Model Bahasa Kecil (SLM) yang baru kami kembangkan telah mencapai kinerja terbaik di kategori 2 miliar parameter pada papan peringkat tolok ukur publik. Dengan penyesuaian menggunakan AI Studio Zoom yang akan datang, SLM Zoom dirancang untuk mendekati kualitas LLM terkemuka di industri dalam beban kerja khusus. Solusi ini membuka jalan bagi AI Companion untuk menjalankan tugas AI agentik yang kompleks, dengan beberapa agen AI bekerja sama secara efektif dan hemat biaya.

Dalam pendekatan AI federasi Zoom, kami tidak mengandalkan satu model besar yang komprehensif, melainkan menggunakan beberapa model yang disesuaikan. SLM Zoom dirancang untuk meningkatkan pendekatan ini dengan mengoptimalkan tugas-tugas spesifik. Dengan mendistribusikan beban kerja ke berbagai SLM yang disesuaikan dan agen yang sesuai—serta memanfaatkan LLM terkemuka — kami bertujuan mencapai beberapa manfaat penting:

Mari kita diskusikan apa arti terobosan ini dan bagaimana tepatnya terobosan ini dibandingkan dengan model-model terkemuka.

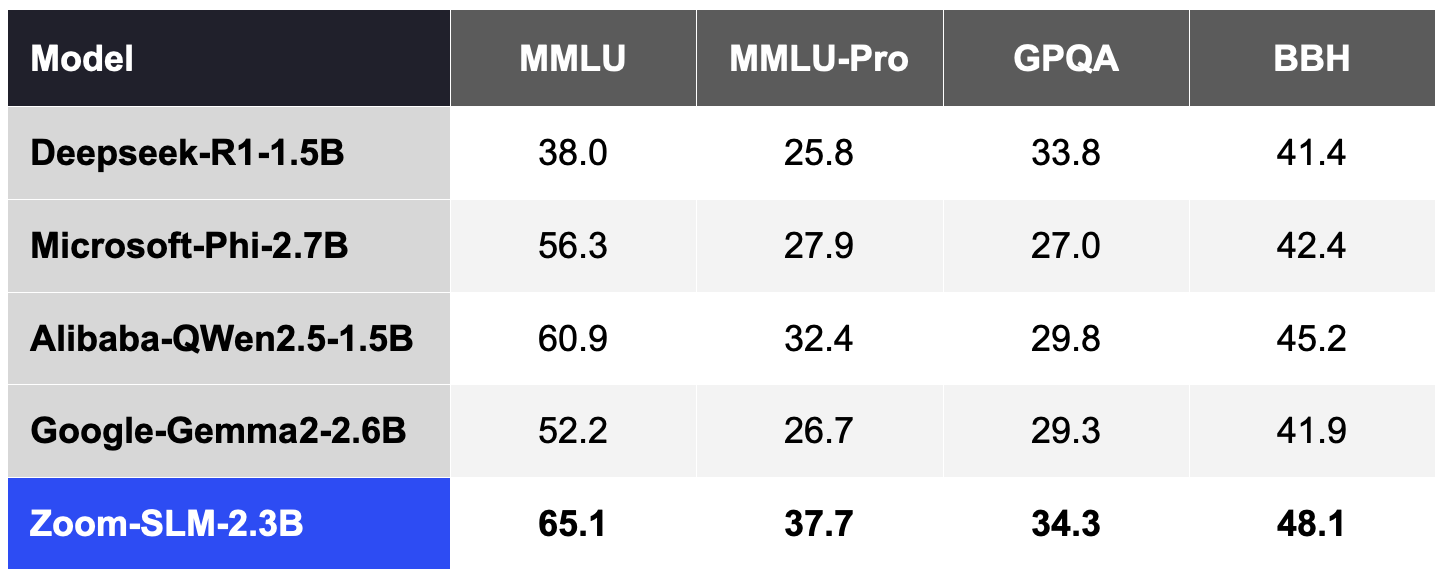

Untuk membuat SLM Zoom, kami menggunakan 6 triliun token data multibahasa dan 256 unit GPU Nvidia H100. Dari awal hingga akhir, seluruh siklus pelatihan berlangsung sekitar 30 hari. Tabel berikut menjelaskan bagaimana kemampuan SLM Zoom dibandingkan dengan model lain untuk beberapa tolok ukur publik berdasarkan pengujian internal kami:

Ketika mengikuti praktik umum komunitas, kami mengevaluasi akurasi tolok ukur tersebut menggunakan alat Lighteval, yang menyediakan 5 contoh pada MMLU dan MMLU-Pro, 2 contoh pada GPQA, serta 3 contoh pada BBH.

Tabel 1. Zoom SLM dibandingkan dengan SLM lainnya dalam kategori 2B (semakin tinggi skornya, semakin baik).

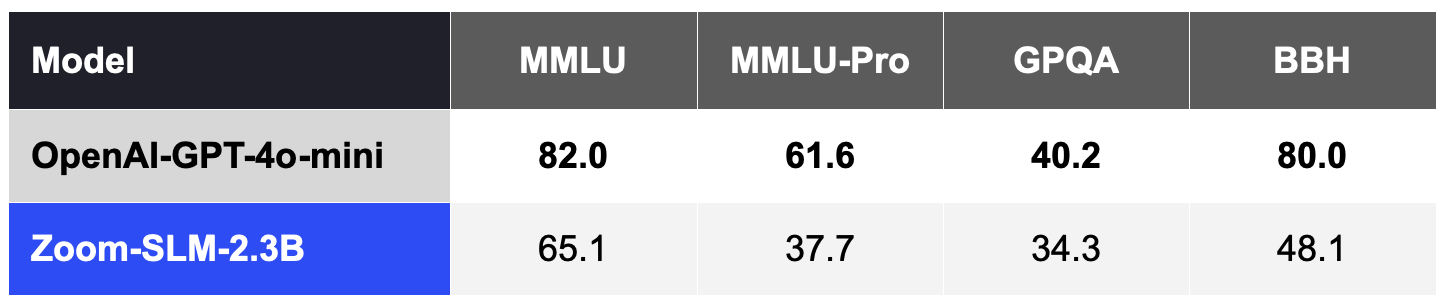

Secara umum, SLM masih kurang kompetitif dalam hal kualitas dibandingkan dengan LLM terkemuka, seperti GPT-4o-mini dari OpenAI, terutama tanpa penyesuaian khusus untuk domain atau tugas tertentu, sebagaimana terlihat pada Tabel 2.

Tabel 2. Zoom SLM, tanpa penyesuaian, kurang kompetitif dibandingkan LLM di luar kategori 2B, seperti OpenAI GPT 4o-mini.

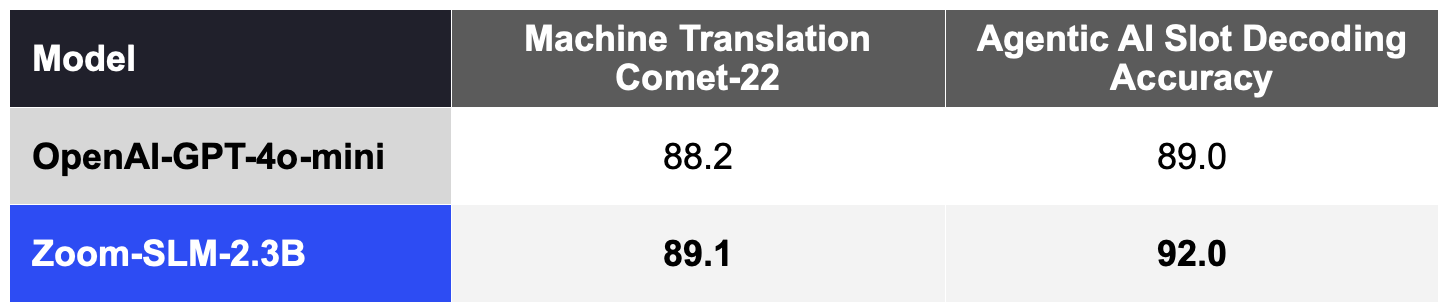

Namun, hasil yang paling menarik adalah SLM ini dapat menawarkan kemampuan luar biasa ketika disesuaikan untuk tugas khusus. Melalui kustomisasi dengan AI Studio Zoom, kami berharap dapat secara efektif mempersempit kesenjangan kualitas dibandingkan dengan LLM yang lebih mahal. SLM yang disesuaikan dapat berfungsi sebagai agen khusus untuk melaksanakan tugas-tugas penting dalam koordinasi dengan LLM, dengan memprioritaskan peningkatan akurasi, kecepatan, dan efisiensi biaya untuk setiap agen AI.

SLM yang disesuaikan dapat unggul dalam tugas seperti penerjemahan mesin. Dengan mengadaptasi SLM dengan 11,5 miliar token (termasuk data sintetis) yang dirancang untuk penerjemahan mesin, kami telah secara signifikan meningkatkan metrik kualitas COMET-22 yang diadopsi secara luas di 14 pasangan bahasa, mencakup bahasa utama seperti Mandarin, Inggris, Prancis, Jepang, Portugis, dan Spanyol. seperti yang ditunjukkan pada Tabel 3.

SLM kami juga dapat disesuaikan untuk mendukung tolok ukur AI Agentik dari AI Companion untuk slot decoding, yang mengukur seberapa baik model menafsirkan perintah pengguna dalam pelaksanaan tindakan. Dengan 2 miliar token sintetis untuk data domain AI agentik, SLM yang disesuaikan juga mengungguli GPT-4o-mini seperti yang ditunjukkan pada Tabel 3.

Kombinasi efisiensi dan kemampuan beradaptasi ini dirancang agar Zoom dapat menghadirkan penerjemahan mesin yang jauh lebih baik kepada pelanggan di seluruh dunia, sekaligus menyediakan dukungan Zoom AI Studio yang dapat disesuaikan dengan beban kerja AI Agentik tertentu.

Tabel 3. Zoom SLM yang disesuaikan vs OpenAI GPT-4o-mini dalam beban kerja khusus, skor yang lebih tinggi lebih baik.

SLM yang disesuaikan ini akan menjadi tulang punggung agen AI kami, beroperasi lebih efisien dan memberikan hasil yang sebanding dengan LLM yang lebih mahal yang saat ini digunakan oleh banyak orang. Dengan menggunakan AI federasi kami, agen dan keterampilan AI ini akan membantu mencapai efisiensi, penghematan biaya, dan akurasi yang tak tertandingi.

Kami bangga dengan kemajuan kami—dan ini baru permulaan. Visi kami adalah melengkapi setiap organisasi dengan agen AI yang menawarkan solusi berkinerja tinggi dan hemat biaya. Dengan dukungan kemampuan dari agen AI dan SLM, AI Companion hadir untuk membantu Anda menciptakan lingkungan kerja yang memungkinkan Anda menyelesaikan lebih banyak tugas dan memberikan hasil terbaik.